Ancaman Baru Agen AI Otonom: Strategi Keamanan Siber Wajib Diterapkan

- Istimewa

- Agen AI kini mengambil keputusan otonom, menjalankan perintah lintas sistem, sehingga menimbulkan kerentanan keamanan baru yang tidak bisa ditangani perangkat konvensional.

- Perusahaan keamanan siber global, Kaspersky, merekomendasikan pendekatan ketat ala Zero Trust untuk membatasi dampak kesalahan atau penyalahgunaan agen AI.

- Strategi mitigasi utama melibatkan pembatasan hak akses (otonomi minimal), isolasi eksekusi agen, dan keterlibatan manusia pada operasi berisiko tinggi.

- Bisnis harus memperkuat pengawasan dengan sistem logging yang aman dan pemantauan anomali perilaku agen.

Pemanfaatan agen AI otonom secara masif menimbulkan tantangan besar bagi dunia usaha saat ini. Sebelumnya, AI hanya berfungsi sebagai alat bantu sederhana untuk analisis atau otomatisasi. Namun, kini agen AI otonom mampu mengambil keputusan strategis, memproses data sensitif, dan menjalankan perintah lintas sistem tanpa intervensi langsung dari manusia.

Perubahan peran AI ini secara otomatis menciptakan celah keamanan siber yang signifikan. Perusahaan keamanan global, Kaspersky, mengingatkan para Chief Information Officer (CIO) dan Chief Information Security Officer (CISO) untuk segera menyesuaikan postur keamanan mereka. Perangkat keamanan TI konvensional terbukti tidak sepenuhnya siap mengatasi risiko yang ditimbulkan oleh agen otonom ini.

Prinsip Zero Trust: Membatasi Akses Agen AI

Kaspersky menyadari bahwa mencapai keamanan 100% pada sistem AI berbasis agen hampir mustahil dilakukan. Oleh karena itu, perusahaan harus mengadopsi pendekatan pengendalian yang sangat ketat dan berlapis. Pendekatan ini sangat mirip dengan prinsip Zero Trust. Tujuannya adalah membatasi dampak negatif saat terjadi kesalahan sistem atau penyalahgunaan izin akses.

Bisnis dapat menerapkan sejumlah langkah mitigasi untuk mengurangi risiko keamanan siber yang muncul dari agen AI. Strategi utama berfokus pada pembatasan kewenangan dan isolasi operasional.

Penerapan Otonomi dan Hak Akses Minimal

Organisasi harus menerapkan prinsip otonomi minimal dan hak akses minimal. Agen AI hanya boleh memiliki wewenang yang benar-benar mereka butuhkan untuk menyelesaikan tugas spesifik. Batasi akses mereka ke alat, API, atau data perusahaan.

Kaspersky menyarankan agar izin akses dikurangi hingga seminimal mungkin. Contohnya, agen sebaiknya hanya diberikan mode baca saja (read-only) jika memungkinkan. Pembatasan ini sangat krusial untuk mencegah eskalasi kerusakan.

Penggunaan Kredensial Berumur Pendek

Penggunaan kredensial sementara (short-lived credentials) wajib dilakukan. Jika agen AI berhasil dikompromikan, token atau kunci API yang berumur pendek akan meminimalkan waktu penyalahgunaan. Kredensial ini harus memiliki cakupan terbatas untuk mengurangi risiko serangan yang meluas.

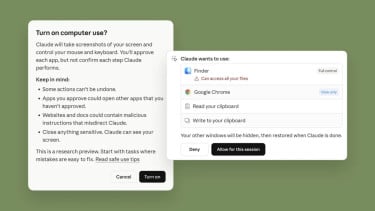

Intervensi Manusia pada Operasi Kritis

Beberapa operasi sangat berisiko dan tidak dapat dibatalkan. Tindakan tersebut, seperti transfer keuangan dalam jumlah besar atau penghapusan data masif, harus tetap memerlukan konfirmasi eksplisit dari manusia. Keterlibatan manusia berfungsi sebagai lapisan pengaman terakhir dalam sistem.

Isolasi Teknis dan Validasi Data Agen AI

Dari sisi teknis, isolasi eksekusi agen AI merupakan aspek vital dalam pengamanan siber. Organisasi perlu memastikan agen dan alat pendukungnya beroperasi dalam lingkungan terisolasi. Gunakan kontainer atau sandbox untuk menciptakan lingkungan yang aman.

Pengendalian Lalu Lintas Jaringan

Isolasi ini membutuhkan kontrol lalu lintas jaringan yang sangat ketat. Tujuannya adalah mencegah panggilan keluar (outbound calls) yang tidak sah. Selain itu, ini juga membatasi penyebaran dampak negatif jika terjadi pelanggaran keamanan.

Validasi Input dan Output Model

Perkuat sistem melalui validasi dan sanitasi input serta output model AI. Setiap permintaan dan respons harus diperiksa secara ketat. Hal ini penting untuk mencegah injeksi perintah atau konten berbahaya, terutama ketika data bergerak antar agen AI otonom yang berbeda.

Pengawasan, Forensik, dan Rantai Pasok Keamanan Siber

Organisasi perlu membangun fondasi pengawasan yang solid. Pencatatan log yang aman dan tidak dapat diubah menjadi dasar penting untuk audit dan investigasi forensik di masa depan. Pemantauan perilaku berbasis sistem otomatis sangat direkomendasikan untuk mendeteksi anomali.

Keunggulan XDR dan SIEM

Organisasi yang telah menerapkan extended detection and response (XDR) dan memproses telemetri di security information and event management (SIEM) akan memiliki keunggulan signifikan. Mereka jauh lebih mudah mengendalikan dan memitigasi risiko dari agen AI otonom. Anomali seperti lonjakan panggilan API atau penyimpangan tujuan agen dapat terdeteksi lebih cepat.

Keamanan Rantai Pasok Perangkat Lunak

Aspek rantai pasok perangkat lunak tidak boleh terabaikan. Batasi penggunaan model dan alat AI hanya pada sumber-sumber tepercaya. Sumber tersebut harus menyediakan dokumentasi software bill of materials (SBOM) yang jelas.

DevSecOps dan Enkripsi Komunikasi

Setiap kode yang dihasilkan oleh agen AI harus melalui analisis statis dan dinamis sebelum dijalankan. Proses ini selaras dengan praktik DevSecOps modern. Selain itu, organisasi harus mengamankan komunikasi antar agen. Pastikan otentikasi dan enkripsi timbal balik diterapkan di semua saluran. Gunakan tanda tangan digital untuk memverifikasi integritas setiap pesan yang dipertukarkan.

Analisis Akhir dan Respon Cepat Terhadap Ancaman

Di tengah meningkatnya risiko agen AI otonom, organisasi perlu menemukan mekanisme respons cepat. Penting untuk segera mengunci agen atau alat tertentu begitu perilaku anomali terdeteksi. Sistem visual dan peringatan tingkat kepercayaan juga harus digunakan. Ini bertujuan mengurangi risiko pengguna manusia terlalu memercayai hasil atau tindakan yang dilakukan oleh AI tanpa verifikasi yang memadai.

Pendekatan proaktif dan berlapis adalah kunci untuk mengelola risiko keamanan siber yang dibawa oleh gelombang AI otonom ini. CIO dan CISO harus menjadikan mitigasi berbasis Zero Trust sebagai prioritas strategis utama.