Pied Piper Beneran Ada! Google Luncurkan TurboQuant Hemat Memori 6x Lipat

Gadget – Dalam dunia teknologi, fiksi kadang menjadi kenyataan dan kali ini, serial HBO Silicon Valley mungkin baru saja kehilangan statusnya sebagai khayalan semata. Google Research resmi memperkenalkan TurboQuant, sebuah algoritma revolusioner yang dirancang untuk mengompresi memori AI secara ekstrem tanpa mengorbankan akurasi.

Sontak, internet pun ramai. Banyak yang menyebut TurboQuant sebagai “Pied Piper versi nyata” merujuk pada startup fiktif di serial Silicon Valley yang memiliki algoritma kompresi ajaib mampu mengecilkan file besar tanpa kehilangan kualitas. Bedanya, jika Pied Piper fokus pada file umum seperti video atau dokumen, TurboQuant menyasar jantung masalah AI modern: krisis memori saat inferensi.

Di tengah kelangkaan chip memori, harga RAM yang melambung, dan tuntutan model AI yang semakin rakus sumber daya, inovasi ini datang di waktu yang tepat. Tapi apakah TurboQuant benar-benar bisa menjadi penyelamat industri AI?

Artikel ini mengupas cara kerja TurboQuant, teknologi di baliknya, potensi dampaknya terhadap industri, serta batasan-batasan yang masih harus diatasi.

Akar Masalah: Mengapa AI Butuh Terlalu Banyak RAM?

Sebelum membahas solusi, penting memahami sumber bottleneck utama dalam sistem AI modern: KV cache (Key-Value cache).

Saat model bahasa besar (LLM) melakukan inferensi misalnya menjawab pertanyaan pengguna ia harus menyimpan representasi sementara dari setiap token yang telah diproses. Data ini disimpan dalam KV cache, yang memungkinkan model “mengingat” konteks percakapan secara real-time.

Masalahnya? KV cache sangat boros memori. Untuk model sekelas Gemini atau GPT-4, ukuran cache ini bisa mencapai puluhan gigabyte bahkan untuk satu permintaan singkat. Ini membuat:

- Biaya operasional AI melambung

- Latensi meningkat

- Skala deployment terbatas, terutama di perangkat edge

- Dan inilah yang ingin dipecahkan oleh TurboQuant.

Cara Kerja TurboQuant: Kompresi Cerdas Tanpa Korbankan Akurasi

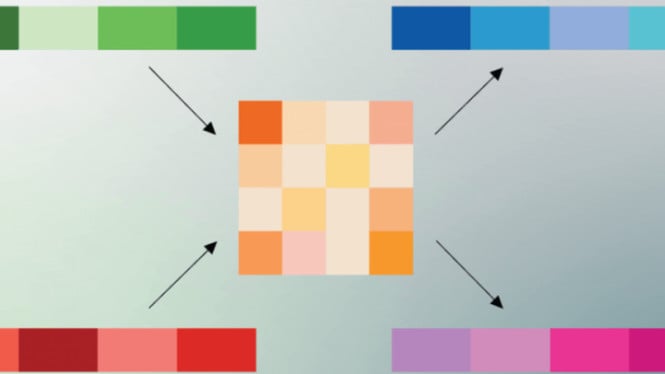

TurboQuant bukan sekadar algoritma kompresi biasa. Ia menggunakan pendekatan canggih berbasis vector quantization teknik yang menyederhanakan representasi data numerik dengan tetap mempertahankan makna strukturalnya.

Namun, Google tidak berhenti di situ. Mereka mengembangkan dua teknik inti yang membuat TurboQuant unggul:

1. PolarQuant: Representasi Data yang Lebih Efisien

PolarQuant mengubah cara vektor dalam KV cache direpresentasikan dari ruang Euclidean ke ruang polar. Dengan pendekatan ini, data yang mirip dikelompokkan lebih rapat, sehingga bisa dikompresi lebih agresif tanpa kehilangan informasi penting.

Hasilnya? Akurasi model tetap stabil, meski ukuran memori berkurang drastis.

2. Quantization-aware Joint Learning (QJL)

Ini adalah bagian paling cerdas dari TurboQuant. Alih-alih mengompresi model setelah dilatih, QJL melatih model sejak awal dengan kesadaran bahwa datanya akan dikuantisasi.

Bayangkan seperti ini:

“Jika kamu tahu nanti fotomu akan dikompresi JPEG, kamu akan menggambar dengan garis yang lebih tegas agar tetap jelas setelah dikompres.”

Begitu pula dengan AI QJL membuat model belajar beradaptasi dengan kompresi, sehingga output akhir tetap presisi.

Efisiensi Luar Biasa: Hemat Memori Hingga 6x Lipat

Menurut tim Google Research, TurboQuant mampu mengurangi penggunaan memori hingga 6 kali lipat dibanding metode konvensional tanpa penurunan signifikan pada akurasi atau kualitas respons.

Contoh konkret:

- Model yang sebelumnya butuh 12 GB RAM untuk inferensi kini hanya butuh 2 GB.

- Server AI bisa menangani 3–5x lebih banyak permintaan simultan dengan infrastruktur yang sama.

- Perangkat mobile atau laptop bisa menjalankan model AI yang sebelumnya hanya mungkin di cloud.

CEO Cloudflare, Matthew Prince, bahkan menyebut peluncuran ini sebagai “momen DeepSeek” bagi Google merujuk pada model AI China yang mengejutkan dunia karena efisiensinya yang luar biasa meski dengan anggaran terbatas.

Apakah TurboQuant Bisa Atasi Krisis RAM AI Secara Keseluruhan?

Sayangnya, belum sepenuhnya.

TurboQuant hanya berfokus pada tahap inferensi, bukan training. Padahal, 80–90% konsumsi RAM dalam siklus hidup AI terjadi saat pelatihan model proses yang membutuhkan ribuan GPU dan ratusan terabyte memori berkecepatan tinggi.

Artinya:

- TurboQuant tidak mengurangi biaya pelatihan.

- Tidak menyelesaikan kelangkaan HBM (High Bandwidth Memory) yang digunakan di chip AI seperti NVIDIA H100.

- Belum bisa mengatasi kenaikan harga DRAM global yang diprediksi berlanjut hingga 2030.

Namun, ini tetap langkah besar. Inferensi adalah tahap yang paling sering dijalankan setiap kali pengguna berinteraksi dengan AI, itulah inferensi. Dengan mengoptimalkannya, Google bisa:

- Menurunkan biaya layanan AI seperti Gemini

- Memperluas akses AI ke perangkat low-end

- Mengurangi jejak karbon data center

- Reaksi Industri dan Potensi Implementasi

Meski masih dalam tahap riset, TurboQuant telah menarik perhatian luas:

- Startup AI melihatnya sebagai cara memangkas biaya operasional.

- Produsen chip seperti AMD dan Intel sedang mengevaluasi integrasi dengan arsitektur mereka.

- Peneliti akademis mulai mengadopsi prinsip PolarQuant dalam eksperimen mereka.

Google belum mengumumkan kapan TurboQuant akan diintegrasikan ke produk komersial seperti Gemini API atau Vertex AI, tapi kemungkinan besar akan hadir dalam 6–12 bulan ke depan.

Kesimpulan: Bukan Solusi Ajaib, Tapi Lompatan Besar Menuju AI yang Lebih Efisien

TurboQuant mungkin bukan “peluru perak” yang mengakhiri krisis memori AI, tapi ia adalah bukti nyata bahwa inovasi algoritmik masih bisa mengimbangi keterbatasan perangkat keras.

Dengan menggabungkan matematika cerdas, pembelajaran adaptif, dan pemahaman mendalam tentang arsitektur AI, Google menunjukkan bahwa efisiensi bukanlah pilihan tapi keharusan di era AI yang semakin terdesentralisasi.

Dan ya meski Pied Piper hanya fiksi, semangatnya kini hidup dalam kode TurboQuant. Dunia nyata akhirnya punya algoritma kompresi yang tak kalah ajaib dari layar kaca. Yang membedakan? Ini benar-benar bekerja.

| Dapatkan informasi terbaru seputar Gadget, Anime, Game, Tech dan Berita lainnya setiap hari melalui social media Gadget VIVA. Ikuti kami di : | |

|---|---|

| @gadgetvivacoid | |

| Gadget VIVA.co.id | |

| X (Twitter) | @gadgetvivacoid |

| Whatsapp Channel | Gadget VIVA |

| Google News | Gadget |